DeepSeekは登場により米国のAI関連企業の株価を大きく下落させるほど、AI界隈に大きな波紋を作りました。

このDeepSeekは、OpenAIのo1と同等の推論モデルでありながら、オープンソースでMITライセンスという形態になっており、すでに派生モデルも登場してきているほど、業界の流れを変えてしまいました。

この記事では、そんなDeepSeekをMacのローカル環境で簡単に実行する手順について説明します。

環境情報

PC:Mac Mini

プロセッサ:Apple silicon (M1以降)

OS:macOS Sonoma

メモリ:16GB推奨

この記事の内容はM1 Macでの実証結果になりますが、M2など他のAppleプロセッサでも変わりません。

DeepSeek-R1について

DeepSeek-R1は、中国のAI企業DeepSeekが開発した最新の大規模言語モデル(LLM)です。2025年1月にリリースされ、推論能力に特化した高性能なAIモデルとして注目を集めています。

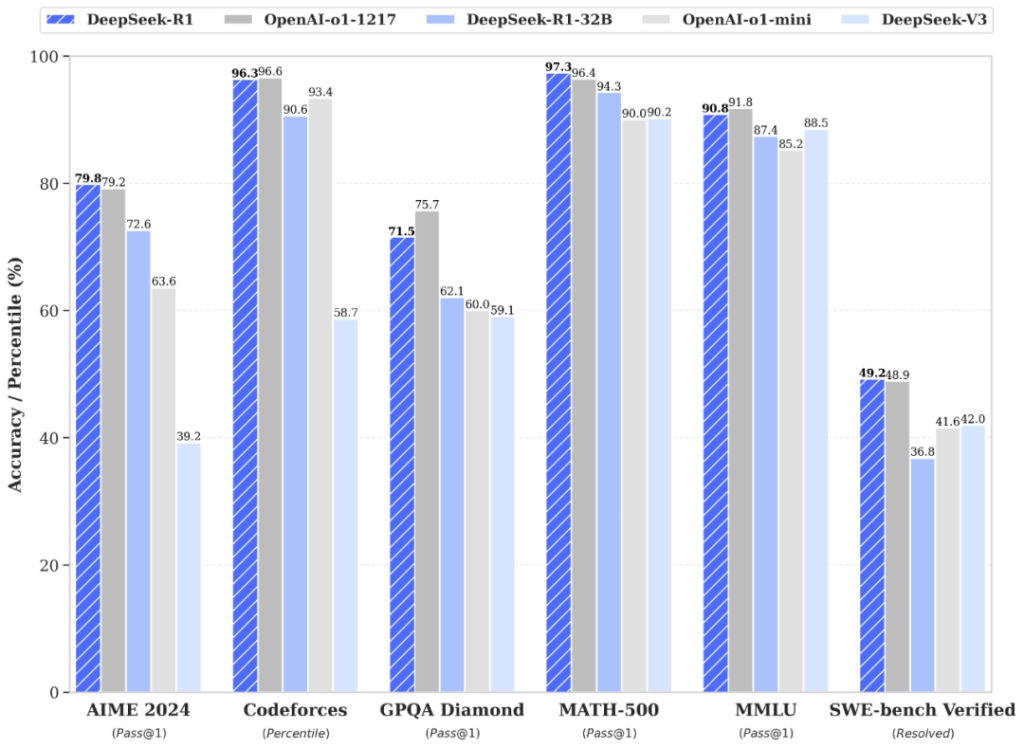

DeepSeek-R1は、数学、コーディング、科学的推論などのタスクにおいて、OpenAIのo1モデルと同等かそれ以上の性能を発揮します。複雑な問題を段階的に解決する能力や、長い思考連鎖(Chain of Thought)の生成が可能となっています。

MITライセンスの下で公開されており、開発者は自由にモデルを利用、改変、商用利用することができて、さらにAPI利用料金がOpenAI o1の約25分の1と非常に安価で、コスト効率が高いのが特徴です。

DeepSeekはこれ前のAIモデルと比較しても高い性能を誇っています。

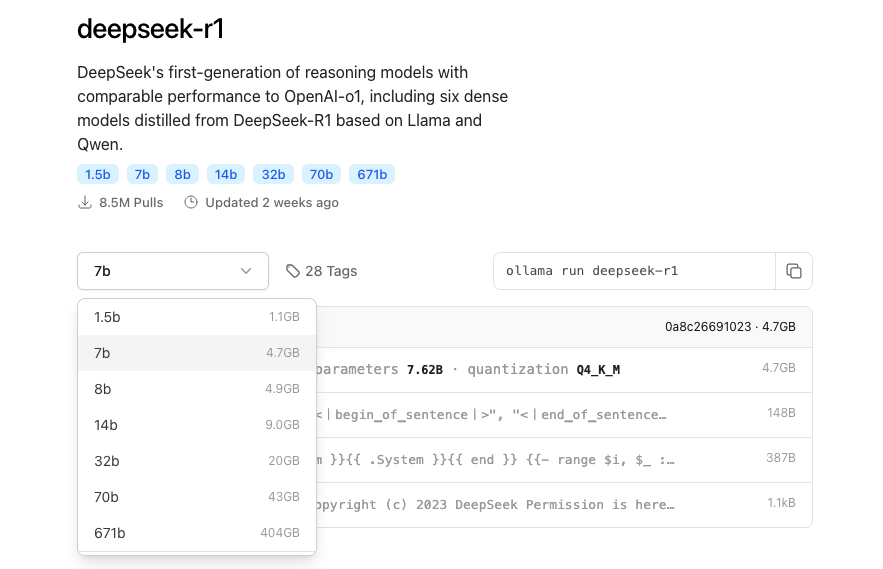

DeepSeek-R1の派生モデル

DeepSeek-R1-Distillモデルは、DeepSeek-R1の知識を小型モデルに転移させた軽量版モデルです。これらのモデルは、元のDeepSeek-R1の高い推論能力を維持しつつ、より小さなサイズと効率的な計算リソースで動作するように設計されています。

DeepSeek-R1-Distillモデルには、以下の6種類があります。

- DeepSeek-R1-Distill-Qwen-1.5B (1.1GB)

- DeepSeek-R1-Distill-Qwen-7B (4.7GB)

- DeepSeek-R1-Distill-Llama-8B (4.9GB)

- DeepSeek-R1-Distill-Qwen-14B (9GB)

- DeepSeek-R1-Distill-Qwen-32B (20GB)

- DeepSeek-R1-Distill-Llama-70B (43GB)

これらのモデルは、Qwen(クウェン)(Alibaba社)やLlama(Meta社)など他社の小型モデルをベースとして、DeepSeek-R1の知識を蒸留しています。

DeepSeekをMacローカルで動かす手順

Ollamaのインストール

まずはOllamaをインストールします。

Ollamaは、コマンドを1つ打つだけで主要なオープンソースモデルをダウンロードし、そのままターミナル上でチャットを開始できる便利なツールです。

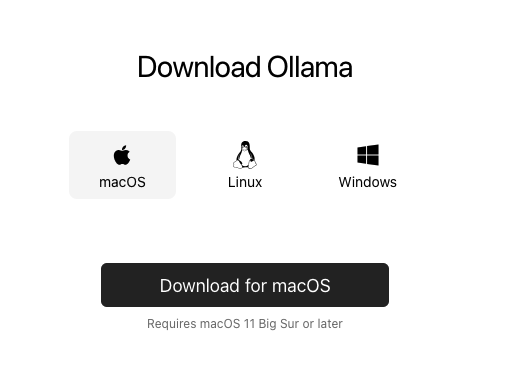

1.Ollamaの公式サイトからアプリをダウンロードします。

2.インストーラーを起動し、「Next」を押す

3.コマンドラインツールをインストールする

これだけで、Macのターミナルからollamaコマンドが使えるようになります。

DeepSeek-R1モデルをダウンロード

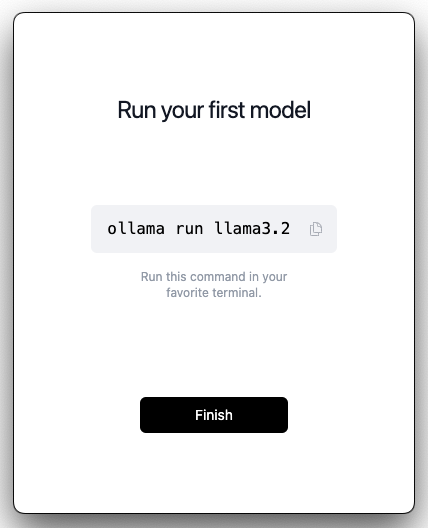

Ollamaの公式モデル一覧からDeepSeek R1のDistilled Modelsを選択しダウンロードコマンドを実行します。

今回は「DeepSeek-R1-Distill-Qwen-7B」のモデルを選択

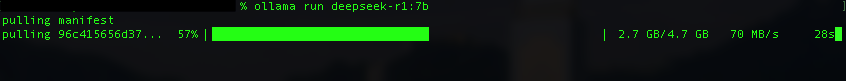

右側に表示されるモデル実行のコマンドをコピーしターミナルで実行します。

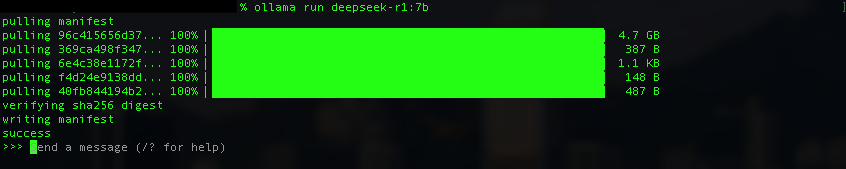

モデルのダウンロードが開始され、ダウンロードが全て完了するとプロンプト入力が可能となりAIモデルを利用することができます。

これでMacローカルでDeepSeekを実行する手順は終了です。2回目からは同じコマンド「ollama run deepseek-r1:7b」を打てばダウンロードなしで、すぐにDeepSeekを利用することが可能です。

ollama listコマンドを使えば、現在ダウンロード済みのAIモデルも確認することが可能です。

% ollama list

NAME ID SIZE MODIFIED

deepseek-r1:7b 0a8c26691023 4.7 GB About an hour ago まとめ

DeepSeekをローカル環境で利用する手順はとても簡単だったのではないでしょうか。ローカル環境で実行できれば、プロンプトデータを学習等に再利用される可能性もなく、安心してデータを入力してAIを活用することが可能です。

今後もどんどん新たなAIモデルが登場すると思います。この手順で色々ダウンロードしてローカル環境で自分なりにモデル比較など実施してみるのも面白いかもしれません。